Parece un recurso de ciencia ficción, pero la tecnología ya está aquí: las estafas por voz IA usan inteligencia artificial para copiar voces reales y suplantar a personas de su confianza. Esto crea un escenario inquietante en el que una voz familiar deja de ser una prueba de que una llamada es legítima.

Las estafas de suplantación de voz IA no se basan en hackear dispositivos o vulnerar sistemas. Los estafadores usan la urgencia y la presión emocional para empujar a la víctima a actuar antes de que pueda cuestionar lo que oye. Las llamadas pueden sonar serenas o extremadamente emotivas y demandantes.

La respuesta más segura es sencilla: cortar la llamada y verificar la petición por otro canal de confianza. Con unos hábitos simples y herramientas básicas, puede reducir el riesgo de caer en estas estafas sin necesidad de conocimientos técnicos.

Lo que debe saber:

- Las estafas por voz IA usan voces clonadas o deepfakes para hacerse pasar por personas de confianza; por eso una voz familiar ya no garantiza que la llamada sea real.

- Estas estafas se basan en la urgencia y la presión emocional, no en intrusiones técnicas, para impedir que verifique las solicitudes.

- Las emergencias familiares y la suplantación de autoridades (jefes o cargos de empresas) son los escenarios más habituales.

- La respuesta más segura es colgar y verificar de forma independiente utilizando datos de contacto fiables.

- Hábitos sencillos como la verificación y el uso de herramientas de filtrado de llamadas pueden reducir significativamente el riesgo.

¿Qué es una estafa por voz IA?

Una estafa por voz IA es un fraude en el que los atacantes usan inteligencia artificial para generar o clonar la voz de una persona y emplearla en llamadas telefónicas o mensajes de voz para engañar a alguien y lograr que realice una acción.

Estas estafas forman parte de la categoría más amplia del phishing, a menudo llamado suplantación por voz o vishing. En lugar de correos electrónicos o mensajes falsos, los estafadores confían en voces que suenan reales para generar confianza y presionar a la persona a actuar deprisa.

Este tipo de ciberdelito ya está teniendo un gran impacto en ciertos sectores, especialmente donde las solicitudes, aprobaciones o interacciones de soporte por teléfono son habituales.

Los estafadores pueden hacerse pasar por un familiar que pide ayuda o dinero con urgencia. También pueden simular ser un responsable que solicita un pago o un agente de soporte que afirma que existe un problema con una cuenta. La voz suena real porque se ha recreado a partir de grabaciones de la persona auténtica.

Las estafas por voz IA son dirigidas e interactivas. Quien llama puede responder de forma natural y ajustar el tono durante la conversación, lo que hace que la situación parezca real y personal, no automatizada como las viejas llamadas robotizadas.

¿Qué es una voz deepfake y cómo se usa en las estafas?

Una voz deepfake es una copia generada con IA de la voz de una persona real que puede usarse para dar credibilidad a una estafa. Esta tecnología sirve para suplantar a alguien que la víctima ya conoce o en quien confía.

Muchos usamos asistentes con voces sintetizadas que muestran lo convincentes que pueden ser las voces generadas. Cada vez son más realistas, hasta el punto de difuminar lo que es auténtico.

Las voces deepfake son una de las herramientas dentro de las estafas por voz IA. A menudo se combinan con datos personales robados para que las llamadas resulten creíbles y urgentes. Por eso la petición puede sonar razonable o verosímil.

Mucha gente asocia los deepfakes con vídeos falsos en Internet más que con llamadas de voz. Esa diferencia de expectativas es la que explotan los estafadores. Cuando una voz le suena familiar, es más fácil que actúe con rapidez sin comprobar nada.

¿Cómo clonan los estafadores la voz de alguien?

Los estafadores clonan voces recopilando fragmentos de audio y empleando herramientas IA para recrear el timbre y la forma de hablar de una persona. A veces bastan unos segundos de habla clara para obtener una aproximación razonable de la voz y la entonación.

Las muestras de voz suelen estar al alcance: vídeos públicos en redes sociales e incluso breves conversaciones telefónicas pueden proporcionar material suficiente. El audio se introduce en herramientas de clonación que aprenden el tono y la pronunciación de la persona. Piense si tiene clips de audio en redes sociales que alguien pudiera usar para esto.

La clonación de voz moderna es rápida y escalable. Lo que antes requería conocimientos muy especializados ahora puede hacerse con rapidez usando herramientas ampliamente disponibles. Esto preocupa porque permite a los estafadores crear voces creíbles y reutilizarlas en múltiples llamadas o víctimas.

¿Por qué resultan tan convincentes las estafas por voz IA?

Las estafas por voz IA son efectivas porque escuchar una voz conocida genera inmediatamente un alto nivel de confianza. En situaciones emocionales o urgentes, las personas no esperan ser engañadas.

Los estafadores suelen crear presión alegando emergencias o problemas con límite de tiempo, por ejemplo que alguien está varado en otra ciudad o incluso en el extranjero sin poder regresar. El pánico y la urgencia reducen la probabilidad de que la víctima se pare a cuestionar lo que oye, aunque la petición resulte inusual o fuera de su carácter habitual.

Por eso hasta las personas más precavidas pueden caer. La estafa no aprovecha una debilidad técnica; explota reacciones humanas normales ante el estrés y la emoción.

Protéjase contra las estafas por voz IA

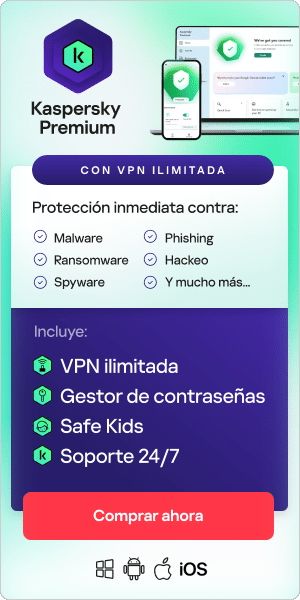

Proteja sus dispositivos con Kaspersky Premium. Evite accesos no autorizados, resguarde sus datos y mantenga su sistema seguro.

Pruebe Premium gratis¿Cuáles son los escenarios más comunes de estafa por voz IA?

La mayoría de las estafas por voz IA siguen situaciones conocidas en las que la gente espera llamadas urgentes y se siente presionada a responder con rapidez. Eso dificulta o hace innecesaria la verificación en el momento.

Estafas por emergencia familiar

Estas estafas usan voces clonadas para crear problemas falsos que afectan a familiares o personas próximas.

Las víctimas suelen recibir llamadas en las que les dicen que alguien ha sido detenido o está herido y necesita dinero con urgencia. El interlocutor puede suplicar ayuda o sonar angustiado. Es habitual que le pidan que no cuelgue ni contacte con nadie más: esa presión emocional busca impedir la verificación y mantener la situación en privado.

El estafador puede exigir pago inmediato o dar instrucciones para permanecer en la línea con explicaciones de por qué los métodos normales de contacto supuestamente no funcionan. El objetivo es la rapidez y el engaño, no mantener largas conversaciones.

Suplantación de autoridad y en el entorno laboral

En estos fraudes se suplantan directivos o personas con roles oficiales y laborales, usando voces serenas y seguras que suenan familiares o profesionales.

Un supuesto nivel de autoridad puede aumentar la probabilidad de que la persona cumpla con lo pedido. Cuando la solicitud parece provenir de un jefe o una institución de confianza, es más probable que se siga la instrucción sin cuestionarla. Las llamadas pueden implicar pagos urgentes o tareas confidenciales (ambas señales de alarma).

Estas estafas afectan tanto a teléfonos personales como laborales porque los atacantes atacan donde ya existe una base de confianza. Pueden dirigirse a un dispositivo de trabajo en horario laboral o al móvil personal fuera de jornada.

¿Qué señales deben alertarle de inmediato?

Una llamada debe levantar sospechas si crea urgencia o presión que le impida verificar la petición por el método que prefiera. Si quien llama reclama secreto o lo hace desde un número desconocido, debe encenderse la alarma.

La persona que intenta estafarle puede insistir en que guarde la llamada en secreto o afirmar que no se puede contactar con otros. Este aislamiento es intencional y busca cortar la posibilidad de verificación o que se dé cuenta de lo que realmente está ocurriendo.

Tenga especial precaución con peticiones que impliquen métodos de pago inusuales o irreversibles, como tarjetas regalo o criptomonedas. Estas solicitudes están diseñadas para mover el dinero con rapidez y dificultar cualquier recuperación. Pedir tarjetas regalo es una señal clara de estafa.

¿Qué debe hacer si recibe una llamada de voz sospechosa?

La acción más segura es colgar y alejarse de la presión. Cualquier indicio de sospecha debe llevarle a cortar la comunicación.

Cuelgue. Esto rompe el control emocional y le da tiempo para pensar con claridad. No se quede en la línea tratando de averiguar nada ni haga preguntas de seguimiento, ya que los estafadores usan la conversación para adaptar su relato y encontrar nuevas formas de hacerlo creíble.

Verifique la petición de forma independiente usando datos de contacto fiables. Insista en tratar el asunto a través de un número guardado o una dirección de correo conocida. Evite continuar la conversación o devolver la llamada al mismo número. Las personas legítimas entenderán que quiera verificar; los estafadores intentarán impedirlo.

¿Cómo puede protegerse a largo plazo frente a las estafas por voz IA?

La protección a largo plazo implica reducir la frecuencia con la que le dirigen estafas y dificultar que los atacantes tengan éxito.

Las estafas por voz IA se aprovechan de la confianza y la urgencia. Hábitos simples y salvaguardas realistas ayudan a minimizar el riesgo sin cambiar su uso del teléfono en el día a día.

Hábitos personales que reducen el riesgo

Pequeños hábitos marcan una gran diferencia. Algunas familias y contactos cercanos usan palabras clave para emergencias reales. Así, una llamada genuina puede verificarse al instante (eso sí, no comparta la palabra clave).

Tenga cuidado con grabaciones públicas de su voz. Vídeos, notas de voz y saludos de buzón pueden usarse como material para clonar. No hace falta dejar de compartir por completo, pero limitar grabaciones largas o muy claras reduce la exposición.

Considere la verificación como algo normal, no como una falta de educación. Colgar para devolver la llamada o consultar con otra persona debería ser habitual. Usar un método de contacto de confianza es una respuesta razonable y cualquier interlocutor legítimo lo entenderá. Los estafadores intentarán disuadirle y mantenerle en la línea, así que usar la verificación funciona como filtro y prueba.

¿Puede el software ayudar a reducir las llamadas de estafa por voz IA?

Hasta cierto punto. Las herramientas de filtrado y detección de spam analizan patrones de llamadas y comportamientos inusuales para bloquear o marcar llamadas sospechosas antes de que las conteste. También pueden identificar números reconocidos por actividades fraudulentas.

Las protecciones a nivel de teléfono pueden reducir la exposición bloqueando campañas de estafa conocidas y advirtiendo sobre fraudes probables. No obstante, no detectan todas las llamadas, ya que existen estafas muy dirigidas que usan números nuevos.

Por eso el software debe ser una capa de apoyo, no un sustituto del juicio personal. La tecnología puede disminuir la frecuencia con la que le llegan estafas, pero la verificación humana sigue siendo la defensa más sólida cuando una llamada suena convincente.

¿Qué debe hacer si ya ha dado dinero o información?

Contacte de inmediato con su banco o proveedor de pagos si ha transferido dinero o facilitado datos bancarios. Cambie contraseñas y active la autenticación multifactor cuanto antes. Si compartió información personal, vigile con atención sus cuentas para detectar actividad inusual.

Actuar con rapidez tras compartir dinero o filtrar información puede limitar daños adicionales y aumentar las posibilidades de recuperar lo perdido.

Documente lo ocurrido mientras la memoria esté fresca. Guarde detalles de la llamada como números y horarios para tener pruebas. También puede anotar las instrucciones que le dieron. Este registro ayuda a proveedores y autoridades a responder más rápido y puede evitar que otras personas sufran la misma estafa.

Por qué es probable que aumenten las estafas por voz IA y cómo mantenerse seguro

Es probable que las estafas por voz IA aumenten porque la voz es una vía que permite a los estafadores suplantar a alguien de forma creíble. A escala, resulta más fácil para los delincuentes explotar esa confianza y la tecnología sigue mejorando.

La familiaridad por sí sola ya no sirve como prueba. Eso no significa que las personas estén indefensas. La verificación sigue funcionando, incluso cuando las estafas resultan más convincentes. Colgar y comprobar la identidad son herramientas efectivas que pueden frustrar una estafa.

Normalizar la verificación y convertirla en una costumbre le devuelve el control. Desarrollar buenos hábitos sigue marcando una gran diferencia y evita que la gente caiga en engaños. La concienciación también significa saber que no todo es lo que parece cuando recibe una llamada.

Artículos relacionados:

- Lo que debe saber sobre las estafas de phishing

- Cómo evitar convertirse en víctima de estafas en línea

- ¿Qué es el vishing?

- Cómo protegerse del cibercrimen con IA

Productos recomendados:

FAQs

¿Pueden los estafadores clonar su voz sin que usted lo sepa?

Sí. Vídeos públicos o grabaciones cortas pueden ser suficientes para clonar una voz sin contacto directo.

¿A quiénes suelen dirigirse las estafas de voz IA?

Cualquiera puede ser objetivo, pero los estafadores suelen centrarse en personas cuyas voces o datos personales son fáciles de encontrar en Internet.

¿Son ilegales las estafas de voz IA?

El fraude, incluida la utilización de voces clonadas para engañar, es ilegal en muchos países, aunque la tecnología en sí pueda ser legal.